- Stable Video Diffusion là gì

- Sử dụng Stable Video Diffusion trên Colab

- Sử dụng Stable Video Diffusion với ComfyUI

- Cài đặt Stable Video Diffusion trên Windows

- Tài nguyên

Stable Video Diffusion là mô hình Stable Diffusion đầu tiên được thiết kế để tạo video. Bạn có thể sử dụng nó để tạo hiệu ứng hình ảnh động được tạo ra bởi Stable Diffusion, tạo ra hiệu ứng hình ảnh tuyệt đẹp.

Sau đây là một số video mẫu:

https://stable-diffusion-art.com/wp-content/uploads/2023/11/060b3b1a23282c2811b4984c06087a12827316242103d23f161fe86f.mp4

https://stable-diffusion-art.com/wp-content/uploads/2023/11/tiger.mp4

https://stable-diffusion-art.com/wp-content/uploads/2023/11/f26f4f5d8a1cc09c8f28eaea0fb78393915ab7686fea1be551384b4e-1.mp4

Trong bài viết này, bạn sẽ tìm hiểu về

- Stable Video Diffusion là gì?

- Cách sử dụng trên Google Colab trực tuyến.

- Cách sử dụng quy trình chuyển đổi văn bản thành video trong ComfyUI.

- Cách cài đặt và sử dụng cục bộ trên Windows.

Stable Video Diffusion là gì

Stable Video Diffusion (SVD) là mô hình video nền tảng đầu tiên được Stability AI, người tạo ra Stable Diffusion, phát hành. Đây là mô hình mã nguồn mở, với mã và trọng số mô hình có sẵn miễn phí.

Nó làm gì

SVD là mô hình chuyển đổi hình ảnh thành video (img2vid). Bạn cung cấp khung hình đầu tiên và mô hình sẽ tạo ra một đoạn video clip ngắn. Dưới đây là ví dụ về đầu vào và đầu ra của mô hình.

https://stable-diffusion-art.com/wp-content/uploads/2023/11/000003.mp4

Mô hình và đào tạo

Mô hình và đào tạo được mô tả trong bài viết Stable Video Diffusion: Scaling Latent Video Diffusion Models to Large Dataset (2023) của Andreas Blattmann và các cộng sự.

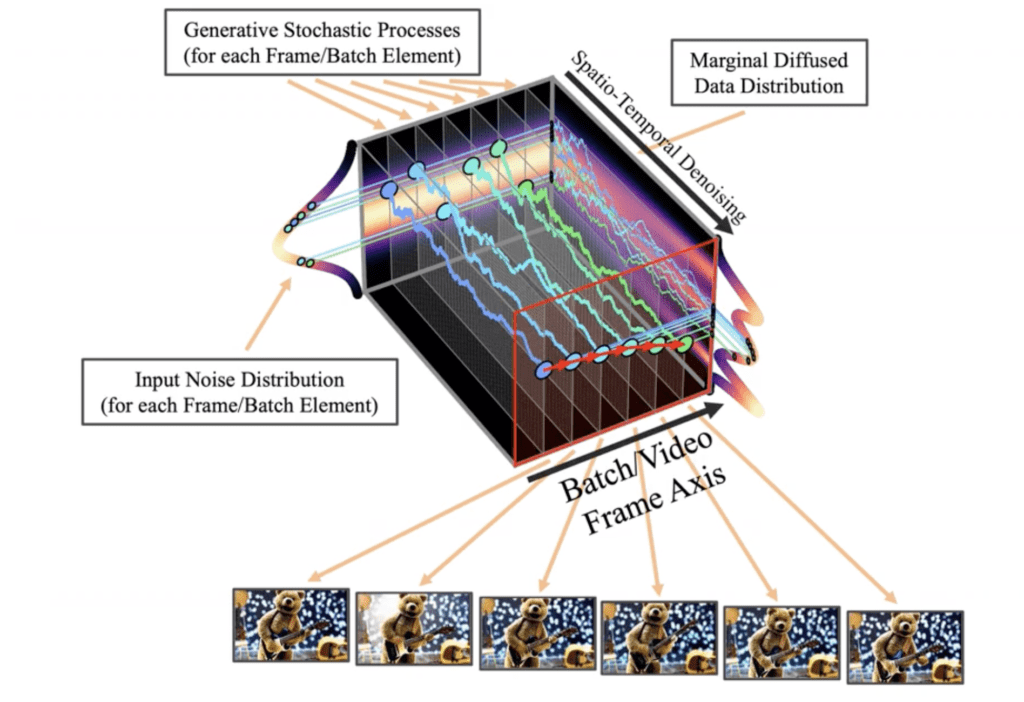

Mô hình SVD đã trải qua 3 giai đoạn đào tạo.

- Đào tạo mô hình hình ảnh.

- Mở rộng mô hình hình ảnh thành mô hình video , sau đó được đào tạo trước với bộ dữ liệu video lớn.

- Tinh chỉnh mô hình video bằng tập dữ liệu video chất lượng cao nhỏ hơn.

Việc tuyển chọn và cải thiện bộ dữ liệu là chìa khóa thành công của mô hình video.

Mô hình hình ảnh là Stable Diffusion 2.1, tiền thân bị lãng quên của mô hình SDXL. Mô hình hình ảnh được đào tạo trước tạo thành xương sống hình ảnh của mô hình video.

Các lớp tích chập thời gian và chú ý được thêm vào bộ ước tính nhiễu U-Net để tạo mô hình video. Bây giờ, tenxơ tiềm ẩn biểu diễn video thay vì hình ảnh. Tất cả các khung hình đều được khử nhiễu bằng khuếch tán ngược cùng một lúc. Mô hình khuếch tán thời gian này giống với mô hình VideoLDM.

Mô hình video có 1,5B tham số và được đào tạo bằng một tập dữ liệu video lớn. Cuối cùng, mô hình video được tinh chỉnh bằng một tập dữ liệu nhỏ hơn nhưng chất lượng cao hơn.

Stable Stable Video Models weights

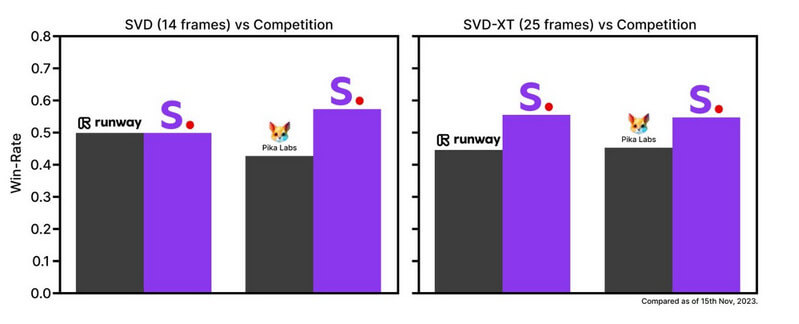

Có hai trọng số mô hình SVD được công bố rộng rãi.

- SVD – được đào tạo để tạo ra 14 khung hình ở độ phân giải 576×1024.

- SVD XT – được đào tạo để tạo ra 25 khung hình ở độ phân giải 576×1024.

Trong bài viết này, chúng tôi sẽ tập trung vào việc sử dụng mô hình SVD XT.

Các thông số mô hình

Dưới đây là danh sách các thông số quan trọng kiểm soát đầu ra video.

Motion bucket id

Motion bucket id kiểm soát lượng chuyển động trong video. Giá trị càng cao thì chuyển động càng nhiều. Chấp nhận giá trị từ 0 đến 255.

FPS

Tham số khung hình trên giây (fps) kiểm soát số khung hình mà mô hình tạo ra. Giữ trong khoảng từ 5 đến 30 để có hiệu suất tối ưu.

Mức độ tăng cường (Augmentation level)

Mức tăng cường là lượng nhiễu được thêm vào hình ảnh ban đầu. Sử dụng mức này để thay đổi hình ảnh ban đầu nhiều hơn hoặc khi tạo video lệch khỏi kích thước mặc định.

Hiệu suất của Stable Video Diffusion so với các mô hình video AI khác như thế nào?

Stability AI đã tự thực hiện nghiên cứu sâu rộng và so sánh mô hình tạo video của mình với các công cụ khác. Theo nghiên cứu, Stable Video Diffusion được so sánh với các mô hình như Runway và Pika Labs.

| Model | Strength | Weakness |

|---|---|---|

| Stable Video Diffusion | Kết quả thực tế và mạch lạc, phù hợp cho video ngắn từ hình ảnh tĩnh | Chiều dài hạn chế, chất lượng thay đổi, khả năng sáng tạo hạn chế |

| Google Video Diffusion | Có thể tạo video dài hơn, tốt cho việc tạo văn bản thành video | Có thể tạo ra lỗi, cần phải tinh chỉnh (không ổn định lắm) |

| DALL-E 2 | Rất sáng tạo và thử nghiệm | Có thể kém ổn định hơn |

| Runway ML | Dễ sử dụng và tốt cho người mới bắt đầu | Khả năng hạn chế và không mạnh bằng các mẫu khác |

| Pika Labs | Mã nguồn mở | Cơ sở người dùng hạn chế, vẫn đang trong quá trình phát triển |

Yêu cầu tính toán để chạy Stable Video Diffusion là gì?

Sau đây là một số yêu cầu để chạy Stable Video Diffusion:

| Yêu cầu | Tối thiểu | Khuyến khích |

|---|---|---|

| Bộ xử lý đồ họa | Bộ nhớ RAM 6GB | 10 GB VRAM (hoặc cao hơn) |

| Bộ vi xử lý | 4 core | 8 lõi (hoặc cao hơn) |

| RAM | 16GB | 32GB (hoặc cao hơn) |

| Storage | 10GB | 20GB (hoặc cao hơn) |

Ngoài ra, bạn nên cài đặt Python 3.10 (hoặc cao hơn) trên hệ thống của mình trước.

Sử dụng Stable Video Diffusion trên Colab

Bạn cần card GPU NVidia VRAM cao để chạy Stable Video Diffusion cục bộ. Nếu bạn không có, lựa chọn tốt nhất là Google Colab trực tuyến. Máy tính xách tay hoạt động với tài khoản miễn phí.

Bước 1: Mở Sổ tay Colab

Đi đến trang GitHub của sổ tay Colab. Cho tôi một ngôi sao (Được rồi, tùy chọn này là tùy chọn…). Nhấp vào biểu tượng Open in Colab để mở sổ tay.

Đây là liên kết trực tiếp đến sổ tay.

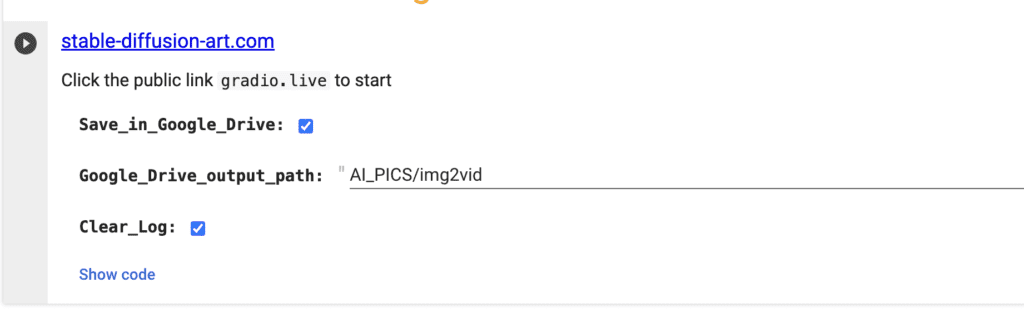

Bước 2: Xem lại tùy chọn sổ ghi chép

Cài đặt mặc định là tốt. Nhưng bạn có thể tùy chọn không lưu video cuối cùng vào Google Drive của mình.

Bước 3: Chạy sổ ghi chép

Nhấp vào nút chạy để bắt đầu chạy sổ ghi chép.

Bước 4: Khởi động GUI

Sau khi tải xong, bạn sẽ thấy liên kết gradio.live . Nhấp vào liên kết để bắt đầu GUI.

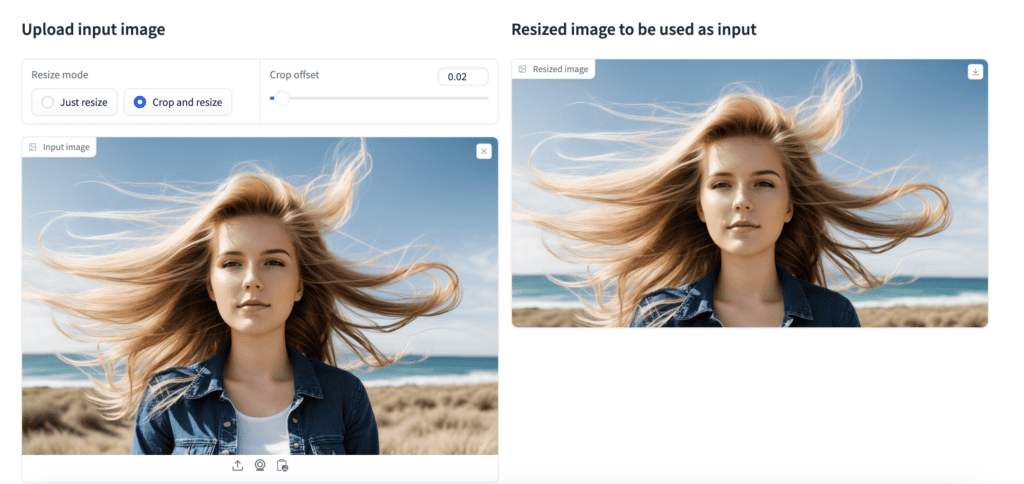

Bước 5: Tải lên hình ảnh ban đầu

Thả một hình ảnh bạn muốn sử dụng làm khung hình đầu tiên của video.

Điều chỉnh độ lệch cắt (crop offset) để điều chỉnh vị trí cắt.

Bước 6: Bắt đầu tạo video

Nhấp vào Run để bắt đầu tạo video. Video sẽ xuất hiện trên GUI khi hoàn tất.

https://stable-diffusion-art.com/wp-content/uploads/2023/11/000003.mp4

Mất khoảng 9 phút trên GPU T4 (tài khoản miễn phí) và 2 phút trên GPU V100.

Tùy chỉnh video của bạn

Bạn có thể tăng thông số ID Motion Bucket trong cài đặt nâng cao để tăng chuyển động trong video.

Sử dụng một số nguyên cố định cho tham số hạt giống (seed) để tạo ra cùng một video.

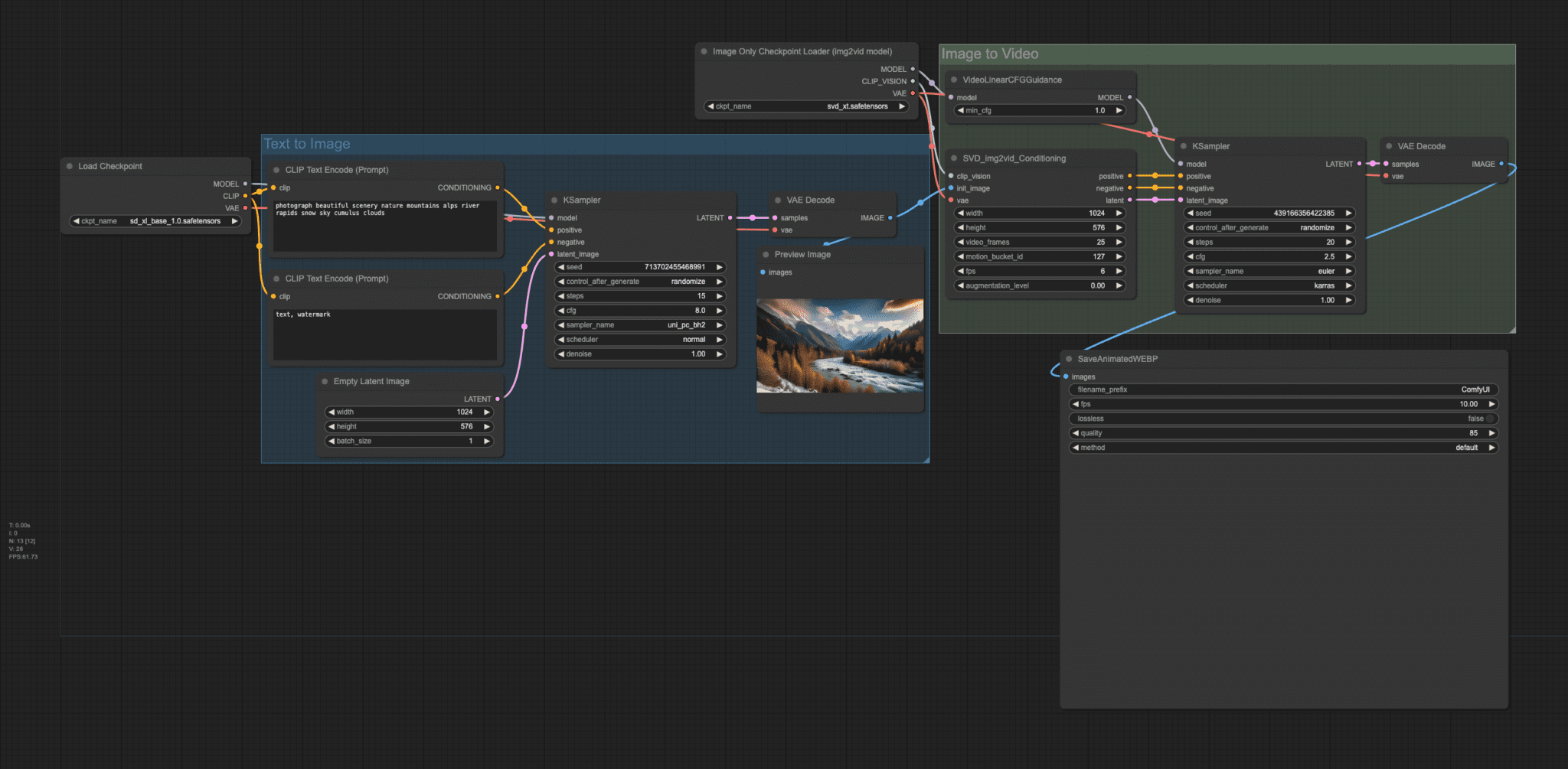

Sử dụng Stable Video Diffusion với ComfyUI

ComfyUI hiện hỗ trợ các mô hình Stable Video Diffusion SVD. Thực hiện theo các bước dưới đây để cài đặt và sử dụng quy trình làm việc text-to-video (txt2vid). Nó tạo ra hình ảnh ban đầu bằng mô hình Stable Diffusion XL và một đoạn video clip bằng mô hình SVD XT.

Đọc hướng dẫn cài đặt ComfyUI và hướng dẫn dành cho người mới bắt đầu sử dụng ComfyUI nếu bạn mới sử dụng ComfyUI.

Nếu bạn sử dụng sổ tay ComfyUI Colab của tôi , hãy chọn các mẫu Stable_Video_Diffusion và SDXL_1 trước khi chạy sổ tay.

Bước 1: Tải quy trình làm việc chuyển văn bản thành video

Tải xuống quy trình làm việc ComfyUI bên dưới.

Kéo và thả nó vào ComfyUI.

Bước 2: Cập nhật ComfyUI

Cập nhật ComfyUI, cài đặt các nút tùy chỉnh bị thiếu và cập nhật tất cả các nút tùy chỉnh. Sử dụng trình quản lý ComfyUI sẽ giúp bước này dễ dàng hơn.

Khởi động lại ComfyUI hoàn toàn và tải lại quy trình làm việc văn bản thành video. ComfyUI sẽ không có khiếu nại nào nếu mọi thứ được cập nhật chính xác.

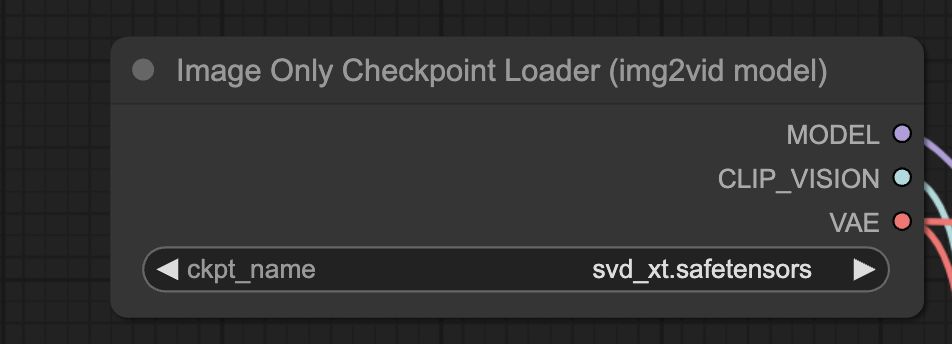

Bước 3: Tải xuống mô hình

Tải xuống mô hình SVD XT. Đặt nó vào thư mục ComfyUI > models > checkpoints.

Làm mới trang ComfyUI và chọn mô hình SVD_XT trong nút Image Only Checkpoint Loader.

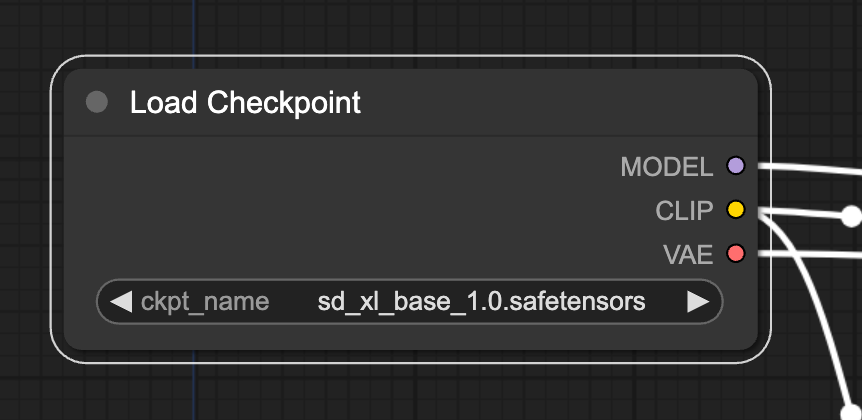

Quy trình làm việc sử dụng mô hình SDXL 1.0. Tải xuống mô hình nếu bạn chưa tải. Đặt nó vào thư mục ComfyUI > models > checkpoints.

Làm mới trang ComfyUI và chọn mô hình SDXL trong nút Load Checkpoint.

Bước 4: Chạy quy trình làm việc

Nhấp vào Queue Prompt để chạy quy trình làm việc. Một video sẽ được tạo ra.

Các tham số

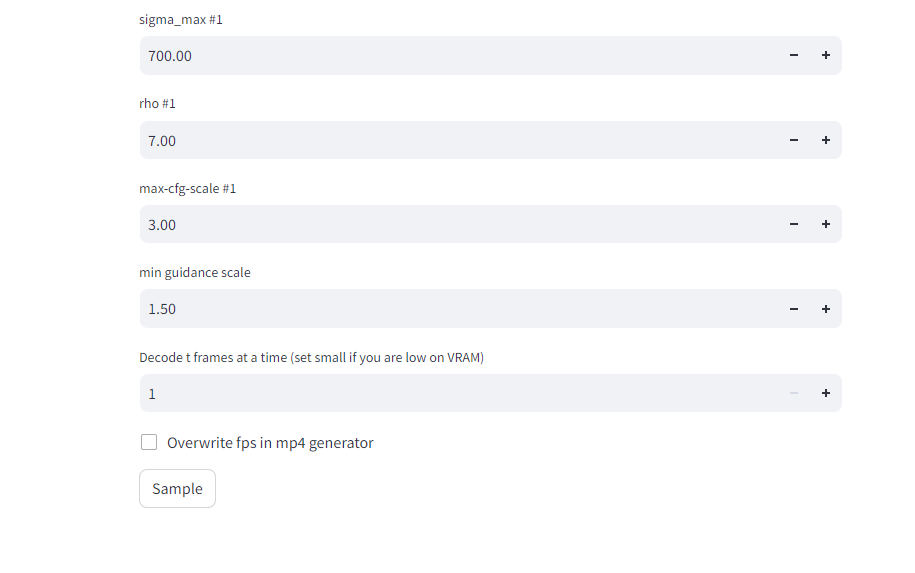

video_frame: Số khung hình. Giữ nguyên ở mức 25 vì đây là số khung hình mà mô hình được đào tạo.

motion_bucket_id: Kiểm soát lượng chuyển động trong video. Giá trị càng cao thì chuyển động càng nhiều.

fps: Khung hình mỗi giây.

Augmentation_level: Lượng nhiễu được thêm vào hình ảnh ban đầu. Càng cao, video càng khác so với khung hình ban đầu. Tăng khi bạn sử dụng kích thước video khác với kích thước mặc định.

min_cfg: Đặt tỷ lệ CFG ở đầu video. Tỷ lệ CFG thay đổi tuyến tính theo giá trị cfg được xác định trong nút KSampler ở cuối video. Trong ví dụ này, min_cfg được đặt thành 1.0 và cfg được đặt thành 2.5. Tỷ lệ CFG là 1.0 cho khung hình đầu tiên, 2.5 cho khung hình cuối cùng và thay đổi tuyến tính ở giữa. Càng xa khung hình đầu tiên, tỷ lệ CFG càng cao.

Cài đặt Stable Video Diffusion trên Windows

Bạn có thể chạy Stable Video Difusion cục bộ nếu bạn có card GPU RAM cao. Quy trình cài đặt sau đây được thử nghiệm với card RTX4090 24GB.

Rất khó để cài đặt phần mềm này cục bộ. Bạn có thể gặp phải các vấn đề không được mô tả trong phần này. Vì vậy, chỉ tiến hành nếu bạn am hiểu công nghệ hoặc muốn…

Bạn sẽ cần git và Python 3.10 để cài đặt và sử dụng phần mềm. Xem hướng dẫn cài đặt Stable Diffusion để biết các bước cài đặt.

Bước 1: Sao chép kho lưu trữ

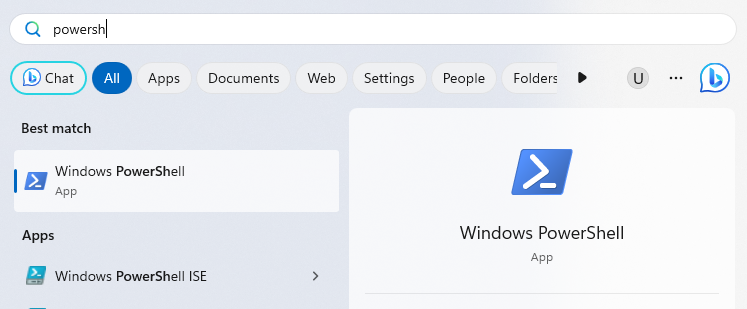

Mở ứng dụng PowerShell. KHÔNG sử dụng Command Prompt (cmd). Nó sẽ không hoạt động với các hướng dẫn này.

Để mở ứng dụng PowerShell, hãy nhấn phím Windows và tìm kiếm “PowerShell”. Nhấp vào ứng dụng Windows PowerShell để bắt đầu.

Trước khi bắt đầu, hãy xác nhận bạn có Python 3.10 bằng cách chạy lệnh sau.

python --version

Bạn có thể tiếp tục nếu nó hiển thị “Python 3.10.x”.

Bạn có thể thay đổi thư mục đến nơi bạn muốn cài đặt phần mềm.

git clone https://github.com/Stability-AI/generative-models

Bước 2: Tạo môi trường ảo

Vào thư mục vừa được sao chép.

cd generative-models

Tạo môi trường ảo.

python -m venv venv

Bạn sẽ thấy thư mục có tên venv được tạo.

Kích hoạt môi trường ảo.

.\venv\Scripts\Activate.ps1

Nếu lệnh này thành công, bạn sẽ thấy (venv) ở phía trước dấu nhắc lệnh. Điều này cho biết bạn hiện đang ở trong môi trường ảo.

Bạn phải ở trong môi trường ảo khi cài đặt hoặc chạy phần mềm.

Nếu bạn không thấy nhãn (venv) ở bước sau, hãy chạy tập lệnh activate.ps1 để vào môi trường ảo.

Bước 3: Xóa gói triton trong yêu cầu

Trong ứng dụng File Explorer, điều hướng đến thư mục generative-models > requirements.

Mở tệp yêu cầu pt2.txt bằng ứng dụng Notepad.

Xóa dòng “triton==2.0.0”. Điều này không thực sự cần thiết và sẽ gây ra lỗi trong Windows.

Lưu và đóng tệp.

Bước 4: Cài đặt các thư viện cần thiết

Quay lại ứng dụng PowerShell. Đảm bảo bạn vẫn thấy nhãn (venv).

Chạy lệnh sau để cài đặt PyTorch.

pip3 install torch==2.0.1 torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

Chạy lệnh sau để cài đặt các thư viện cần thiết.

pip3 install -r .\requirements\pt2.txt

Chạy lệnh sau để cài đặt phần mềm mô hình tạo sinh.

pip3 install .

Chạy lệnh sau để cài đặt thư viện cần thiết.

pip3 install -e git+https://github.com/Stability-AI/datapipelines.git@main#egg=sdata

Bước 5: Tải xuống mô hình video

Trong ứng dụng File Explorer, hãy điều hướng đến thư mục generative-models và tạo một thư mục có tên là “checkpoints”.

Điều hướng đến thư mục generative-models > checkpoints.

Tải xuống mô hình safetensors (svd_xt.safetensors) và đặt nó vào thư mục mô hình điểm kiểm tra.

Bước 6: Chạy GUI

Quay lại ứng dụng PowerShell. Bạn sẽ ở trong thư mục generative-models và trong môi trường ảo.

Chạy lệnh sau để thiết lập đường dẫn Python.

$ENV:PYTHONPATH=$PWD

Chạy lệnh sau để khởi động GUI.

streamlit run scripts/demo/video_sampling.py

Một trang web mới sẽ được mở. Nếu không, hãy xem bản in của thiết bị đầu cuối PowerApp. Đi đến URL cục bộ. Nó sẽ giống như thế này:

http://localhost:8501

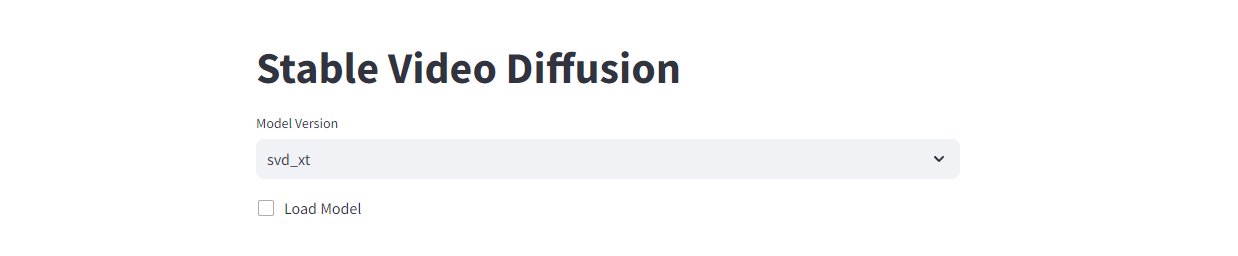

Bước 7: Tạo video

Trong menu thả xuống Model Version, chọn svd_xt.

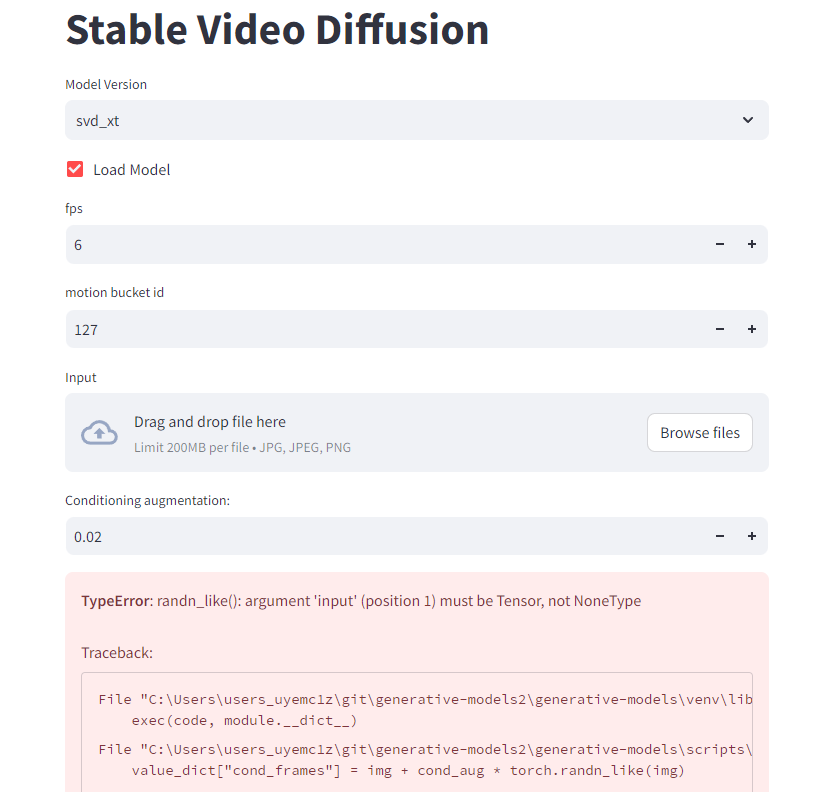

Nhấp vào hộp kiểm Load Model.

Hãy chú ý đến lỗi của thiết bị đầu cuối PowerShell.

Nó có thể hiển thị thông báo lỗi trong GUI. Nhưng không sao miễn là phần Input mới xuất hiện.

Thả một hình ảnh làm khung ban đầu vào hộp Input.

Cuộn xuống và tìm trường Decode t frames at a time. Đặt thành 1.

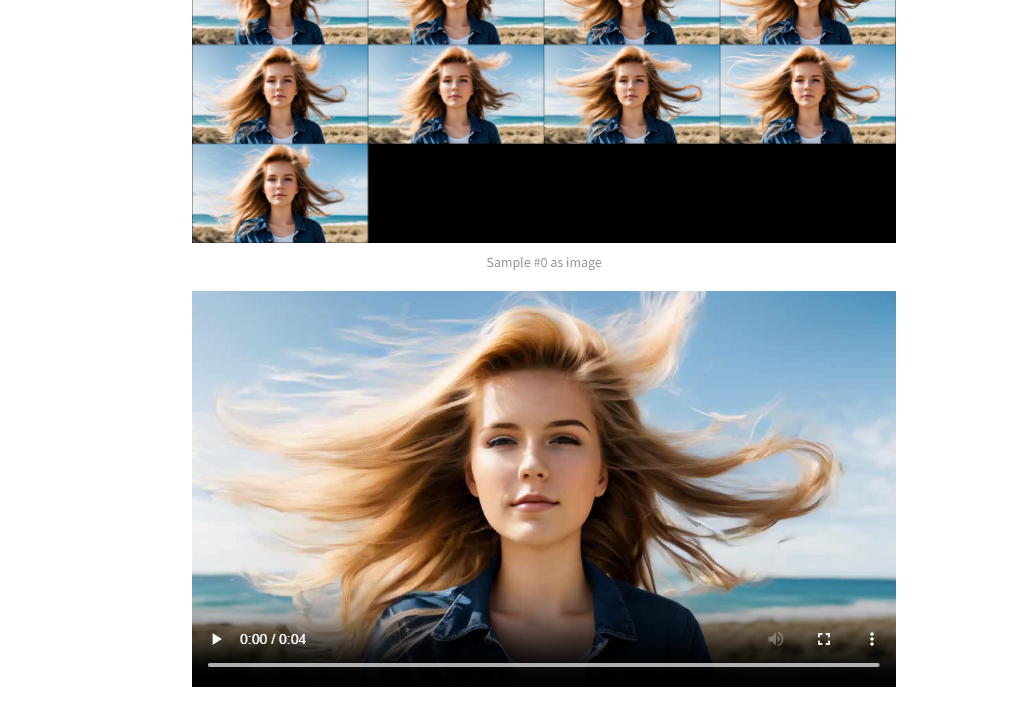

Nhấp vào Sample để bắt đầu tạo video.

Theo dõi tiến trình trên thiết bị đầu cuối PowerShell.

Khi hoàn tất, video sẽ hiển thị trên GUI.

Đóng ứng dụng PowerShell khi bạn thực hiện xong.

Bắt đầu lại GUI

Để khởi động lại GUI, hãy mở Ứng dụng PowerShell.

Điều hướng đến thư mục generative-models.

cd generative-models

Kích hoạt môi trường ảo.

.\venv\Scripts\Activate.ps1

Chạy lệnh sau để thiết lập đường dẫn Python.

$ENV:PYTHONPATH=$PWD

Chạy lệnh sau để khởi động GUI.

streamlit run scripts/demo/video_sampling.py

Tài nguyên

Stable Video Diffusion Colab notebook

Introducing Stable Video Diffusion – Official press release of SVD.

Stable Video Diffusion: Scaling Latent Video Diffusion Models to Large Datasets – The research paper.

Stability-AI/generative-models: Generative Models by Stability AI – code on GitHub page.

stabilityai/stable-video-diffusion-img2vid-xt – Model weights on Hugging Face.

Tham khảo:

- How to run Stable Video Diffusion img2vid

- Stable Video Diffusion: Here’s Everything You Need to Know